研究人员使用AI和音频来预测物体将落在何处

发布时间:2020-07-08 13:10:08 【来源:】

卡内基梅隆大学的研究人员在一项新的预印本研究中声称,声音可以用来预测物体的外观及其运动。合著者创建了一个“声音动作视觉”数据集和一系列AI算法,以研究音频,视觉和运动之间的相互作用。他们说,结果表明,从声音中得出的表示可以用来预测物体在受到物理力作用时将移动的位置。

尽管视觉是感知的基础,但声音却同样重要。它可以捕获通常通过视觉或力数据无法察觉的丰富信息,例如干树叶的质地或香槟酒瓶内的压力。但是很少有系统和算法利用声音作为建立物理理解的工具。这种监督激励了卡内基梅隆大学的研究,该研究试图探索声音与动作之间的协同作用,并发现可能做出什么样的推断。

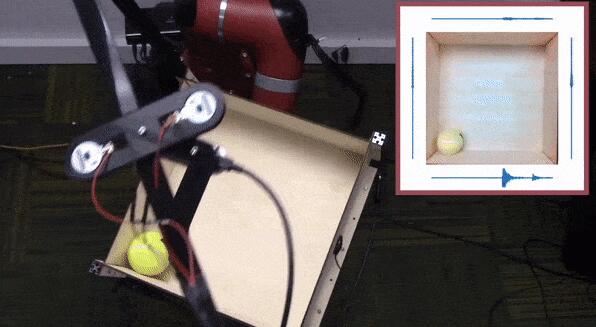

研究人员首先通过构建一个机器人Til-Bot来创建声音动作视觉数据集,该机器人将包括螺丝刀,剪刀,网球,立方体和夹子在内的物体沿任意方向倾斜放在托盘上。这些物体撞击石膏托盘的薄壁并产生声音,这些声音被逐一添加到语料库中。

安装在30×30厘米托盘上的四个麦克风(每侧一个)记录音频,而高架摄像机则捕获RGB和深度信息。Tilt-Bot将每个对象移动了一个小时,并且每次对象与托盘接触时,机器人都会创建一个包含声音,RGB和深度数据的日志,并跟踪对象与墙壁碰撞时的位置。

利用碰撞中的录音,该团队使用了一种方法,使他们能够将录音视为图像。这允许模型捕获来自单个音频通道的时间相关性(即,一个麦克风的录音)以及多个音频通道之间的相关性(来自多个麦克风的录音)。

然后,研究人员使用了语料库(其中包含来自60多个物体和托盘之间15,000次碰撞的声音)来训练模型以从音频中识别物体。在第二个更具挑战性的练习中,他们训练了一个模型来预测对看不见的对象执行了哪些操作。第三,他们训练了一种前向预测模型,以在物体被机械臂推动后暂定物体的位置。

研究人员称,对象识别模型学会了从声音中预测正确的对象的时间为79.2%,只有在生成的声音太柔和时才会失败。同时,动作预测模型在一组30个以前看不见的物体上实现了0.027的均方误差,比仅使用来自摄像机的图像训练的模型要好42%。而且,前向预测模型在预测对象可能移动的位置时更为准确。

研究人员写道:“在某些领域,例如正向模型学习,我们证明声音实际上提供的信息多于仅从视觉信息获得的信息。”“我们希望将与我们的发现一起公开发布的Tilt-Bot数据集将激励声音操作领域的未来工作,并在机器人技术中找到广泛的适用性。”

始祖鸟之家双面派对,设计师系列惊艳亮相

11月24日,被誉为户外爱马仕的始祖鸟(ARC’TERYX)全新概念店——始祖鸟之家在全国顶级商圈北京国贸开业了。现场门店实拍图片 ...

曝小米显示器34寸本月最后一单出货后将暂停供应 因三星无屏供应原因

本月初,视讯堂消息称小米的 34 寸带鱼屏显示器型号,之后可能无法再保持 1999 元的价格进行销售。今天,视讯堂发布最新消息,称小 ...

微星Stealth 15M超轻游戏本纯净白即将上架 屏幕为15.6英寸

根据微星笔记本官方的消息,微星 Stealth 15M (纯净白)即将上架预约,这款笔记本是首款采用 11 代低压酷睿 + RTX 2060 配置的 ...

EG7今天宣布收购《机甲战士5》开发商Piranha Games 增加其游戏公司种类

Enad Global 7(EG7)今天(11 27)宣布收购《机甲战士5》开发商Piranha Games,增加了其游戏公司的种类。 EG7已同意以2410万美元的 ...

华米将推出GTS 2 mini手表:将于12月1日发布 外观更轻薄更精致

根据华米创始人黄汪的消息,华米将推出 GTS 2 mini 手表,外观更轻薄更精致。 根据华米微博的消息, GTS 2 mini 手表将 ...

冬季必看的小黑裤穿搭指南|九牧王男裤专家

伴随着秋冬而来的除了购物欲还有穿搭热情,但如果你正苦于衣服少、缺乏穿搭灵感,那么,一条百搭、舒适的九牧王小黑裤,或许可以帮到你,只 ...

- Copyright © 2013-2020 All rights reserved

- 联系我们 QQ: 3 38 52 5 5 3 9 0